无人驾驶如何感知?无人驾驶如何定位?

65

65

拍明

拍明

原标题:无人驾驶如何感知?无人驾驶如何定位?

无人驾驶汽车主要通过以下方式感知和定位:

感知

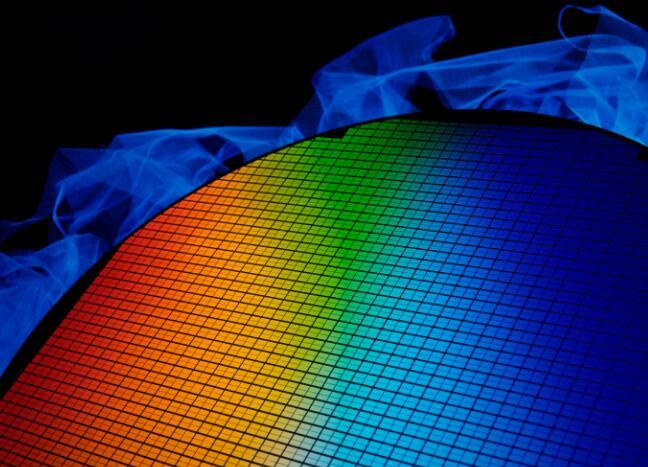

无人驾驶汽车通过车载传感器来实现“听”和“看”,从而感知周围环境。这些传感器主要包括摄像头、毫米波雷达、激光雷达、超声波传感器以及听觉传感器。

摄像头:摄像头采集图像,并将图像转换为二维数据。通过图像匹配算法,可以识别行驶过程中的车辆、行人、交通标志等。摄像头获取的图像信息量大,且成本相对较低,但受光线、天气影响较大,在复杂交通环境下可能存在目标检测困难的问题。

毫米波雷达:毫米波雷达通过发射无线电信号并接收反射信号来测定汽车车身周围的物理环境信息,如汽车与其他物体之间的相对距离、相对速度、角度、运动方向等。毫米波雷达不受天气状况限制,穿透雾、烟、灰尘的能力强,具有全天候、全天时的工作特性,且探测距离远、探测精度高。但毫米波雷达精度相对较低,可视范围的角度偏小,且对金属表面非常敏感,可能产生误判。

激光雷达:激光雷达可以创建周围环境的点云表征,提供摄像头难以提供的一些信息,如距离和高度。激光雷达使用激光来测量自身与环境中的物体之间的距离,通过构建环境的视觉表征来帮助无人驾驶汽车感知周围环境。激光雷达可以获得极高的角度、距离和速度分辨率,但成本相对较高。

超声波传感器:超声波传感器多用于测距,其基本原理是通过测量超声波发射脉冲和接收脉冲的时间差,结合空气中超声波的传输速度来计算相对距离。超声波测距对恶劣天气不敏感,穿透性强、衰减小,且对外界电磁场不敏感。但超声波测距速度相对较慢,且无法测量方位,应用领域受限。

听觉传感器:听觉传感器用于感知环境中的声音信息,如喇叭、警笛等。通过麦克风阵列采集车体内部及外界环境中的声音信息,智能驾驶车辆可以对环境中的声音有所感知并做出反应。

这些传感器共同工作,为无人驾驶汽车提供了丰富的环境感知信息。

定位

无人驾驶汽车的定位方法主要包括卫星定位、磁感应定位、惯性导航定位以及基于视觉或激光的地图信息匹配定位等。

卫星定位:卫星定位是一种绝对姿态测量方法,如全球定位系统(GPS)。GPS通过人造地球卫星进行无线电导航和定位,可以提供目标的地理位置、车行速度及时间信息。但GPS存在定位精度和更新频率的问题,民用的GPS精度通常在几米范围内,且更新频率较低(约10Hz),对于无人驾驶汽车来说可能不够精确和及时。因此,无人驾驶汽车通常会结合其他定位方法来提高定位精度和实时性。

磁感应定位:磁感应定位通过在车道上安装磁钉并记录磁钉的绝对位置来实现。车辆运动过程中,根据车辆经过的磁钉可以检测车辆相对磁钉的位置,进而获取车辆的定位信息。这种方法成本相对较低,但需要在车道上安装磁钉,实施起来可能较为困难。

惯性导航定位:惯性导航定位利用惯性测量单元(IMU)通过汽车的初始速度、加速度和初始位置来计算汽车的位置和速度。IMU由加速度计和陀螺仪构成,可以测量汽车的运动形态和姿态。惯性导航定位更新频率高,但存在误差累积的问题,因此通常需要与其他定位方法结合使用。

基于视觉或激光的地图信息匹配定位:这种方法通过构建的局部高精度地图来实现在局部环境中的相对高精度定位。无人驾驶汽车将传感器所感知的内容与地图上所显示的内容进行比较和匹配,从而确定自身位置。这种方法可以提供较高的定位精度,但需要预先构建高精度地图,并且对于复杂环境的变化可能需要实时更新地图信息。

综上所述,无人驾驶汽车通过车载传感器感知周围环境,并通过多种定位方法结合使用来确定自身位置。这些感知和定位技术为无人驾驶汽车的安全行驶提供了重要保障。

责任编辑:David

【免责声明】

1、本文内容、数据、图表等来源于网络引用或其他公开资料,版权归属原作者、原发表出处。若版权所有方对本文的引用持有异议,请联系拍明芯城(marketing@iczoom.com),本方将及时处理。

2、本文的引用仅供读者交流学习使用,不涉及商业目的。

3、本文内容仅代表作者观点,拍明芯城不对内容的准确性、可靠性或完整性提供明示或暗示的保证。读者阅读本文后做出的决定或行为,是基于自主意愿和独立判断做出的,请读者明确相关结果。

4、如需转载本方拥有版权的文章,请联系拍明芯城(marketing@iczoom.com)注明“转载原因”。未经允许私自转载拍明芯城将保留追究其法律责任的权利。

拍明芯城拥有对此声明的最终解释权。

产品分类

产品分类

2012- 2022 拍明芯城ICZOOM.com 版权所有 客服热线:400-693-8369 (9:00-18:00)

2012- 2022 拍明芯城ICZOOM.com 版权所有 客服热线:400-693-8369 (9:00-18:00)