基于RV1126开发板实现人脸检测方案

2

2

拍明芯城

拍明芯城

基于RV1126开发板实现高鲁棒性人脸检测方案

随着人工智能技术的飞速发展,人脸检测作为计算机视觉领域的基础技术,在安防监控、智能门禁、智慧零售、活体识别等多个应用场景中扮演着越来越重要的角色。瑞芯微(Rockchip)推出的RV1126是一款高性能、低功耗的AIoT视觉处理器,其内置的NPU(神经网络处理器)为在边缘侧实现复杂的人工智能算法提供了强大的算力支持。本文将详细探讨基于RV1126开发板实现高鲁棒性人脸检测的整体方案,从硬件选型到软件实现,力求为开发者提供一份全面且实用的指南。

1. 方案概述与设计理念

本方案旨在利用RV1126芯片的强大AI算力,结合优化的深度学习模型,实现高效、精准且鲁棒性强的人脸检测功能。鲁棒性意味着系统在光照变化、姿态偏转、遮挡、多人场景等复杂环境下依然能够保持良好的检测性能。整体设计理念围绕“高性能计算、低功耗运行、边缘侧部署、实时响应”展开。我们将充分利用RV1126的硬件加速能力,将人脸检测模型部署到NPU上运行,从而显著提升推理速度,降低CPU负载。同时,考虑到实际应用场景的复杂性,方案将不仅关注检测精度,还将重视模型的轻量化和系统的稳定性。

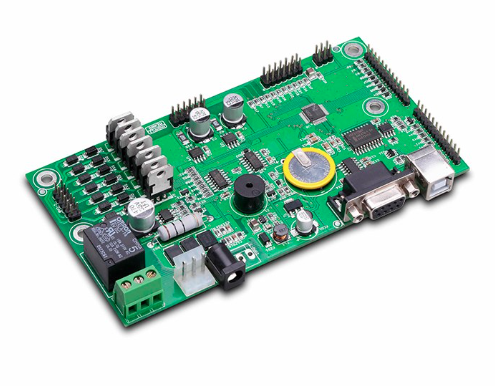

2. 核心元器件选型与分析

RV1126开发板作为本方案的核心平台,其周边元器件的选择对于最终方案的性能、稳定性和成本至关重要。以下将详细介绍各项关键元器件的选型及原因。

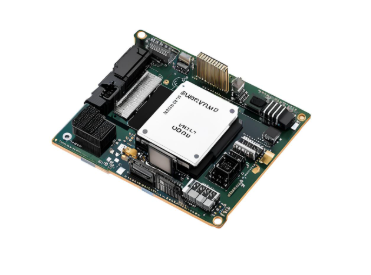

2.1. 核心处理器:Rockchip RV1126

型号选择: Rockchip RV1126。

器件作用: RV1126是整个系统的“大脑”,负责图像数据的采集、预处理、人脸检测算法的推理计算(主要通过内置NPU)、结果输出以及与外部设备的通信协调。

选择原因: RV1126专为AI视觉应用设计,其核心优势在于集成了高性能的NPU,算力高达2.0 TOPS,支持INT8/INT16混合量化,这对于深度学习模型的高效部署至关重要。此外,它内置了Cortex-A7 CPU、H.265/H.264编解码器,并支持多路MIPI CSI接口,能够满足多摄像头输入的需求。其低功耗特性也使其非常适合边缘侧部署和长时间运行。

功能:

NPU(神经网络处理器): 加速深度学习模型推理,大幅提升人脸检测速度。

Cortex-A7 CPU: 处理操作系统、应用程序逻辑、外设控制和模型后处理。

ISP(图像信号处理器): 对摄像头原始数据进行去噪、白平衡、色彩校正、宽动态(WDR)等处理,输出高质量的图像,为人脸检测提供更好的输入。

视频编解码器: 支持H.265/H.264视频编码和解码,便于视频流传输和存储。

MIPI CSI接口: 高速连接摄像头模组,支持多路视频输入。

丰富外设接口: 包括UART、SPI、I2C、GPIO、USB等,方便扩展其他传感器和模块。

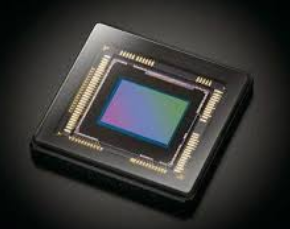

2.2. 图像传感器(摄像头模组)

型号选择: 推荐选择SONY IMX307或IMX327等星光级CMOS图像传感器模组。也可根据成本和具体应用场景选择OV系列传感器如OV4689。

器件作用: 捕获外部环境的可见光图像,并将其转换为数字信号。其性能直接影响人脸检测的输入图像质量。

选择原因: 人脸检测在实际应用中经常面临复杂的光照条件,例如逆光、弱光、高对比度等。SONY IMX系列传感器以其卓越的低照度性能、高动态范围(HDR/WDR)以及出色的色彩还原能力而闻名,能够提供清晰、低噪声的图像,极大地提高了在复杂光照环境下人脸检测的准确率和鲁棒性。这些传感器通常支持MIPI CSI接口,与RV1126无缝对接。如果对成本敏感,OV系列传感器也是不错的选择,但需评估其在极端光照下的表现。

功能:

感光成像: 将光信号转换为电信号。

模数转换(ADC): 将模拟电信号转换为数字信号。

图像输出: 通过MIPI CSI接口将原始或经过简单处理的图像数据传输给RV1126的ISP。

低照度性能: 在光线不足条件下依然能捕捉到清晰图像。

宽动态范围(WDR): 在光照对比强烈的场景下,同时捕捉到过亮和过暗区域的细节。

2.3. 存储器:DDR3/DDR4 SDRAM & eMMC/NAND Flash

型号选择:

DDR3/DDR4 SDRAM: 推荐至少2GB或4GB,例如海力士(Hynix)H5TQ4G63AFR (DDR3) 或三星(Samsung)K4A4G165WE-BCRC (DDR4)。

eMMC/NAND Flash: 推荐至少8GB或16GB,例如三星(Samsung)KLMBG2JETD-B041 (eMMC)。

器件作用:

DDR SDRAM: 用作RV1126的运行内存,存储操作系统、应用程序代码、图像帧数据以及神经网络模型的中间激活值。更大的内存容量有利于运行更复杂的模型和处理更高分辨率的图像。

eMMC/NAND Flash: 用作RV1126的非易失性存储,存储操作系统镜像、文件系统、应用程序、配置文件和训练好的深度学习模型权重。

选择原因:

DDR SDRAM: RV1126支持DDR3和DDR4,DDR4相比DDR3具有更高的数据传输速率和更低的功耗,有利于提高系统性能。选择足够的容量(2GB或4GB)是为了确保系统能够流畅运行,特别是在处理高分辨率视频流和加载大型深度学习模型时,充裕的内存能避免OOM(Out Of Memory)问题。

eMMC/NAND Flash: eMMC具有集成控制器,接口简单,读写速度快,更适合作为嵌入式系统的启动介质和主要存储。8GB或16GB的容量通常足够存储RV1126的Linux系统、人脸检测应用程序和模型文件。

功能:

DDR SDRAM: 提供高速的随机存取能力,供CPU和NPU访问数据。

eMMC/NAND Flash: 提供持久化的数据存储,用于系统启动和应用程序加载。

2.4. 电源管理单元(PMU)

型号选择: RK809或RK806等Rockchip配套PMU芯片。

器件作用: 为RV1126及其周边元器件提供稳定、可靠的多路供电电压。PMU集成了多种电源管理功能,如降压转换器(Buck Converter)、升压转换器(Boost Converter)、低压差线性稳压器(LDO)等。

选择原因: Rockchip官方推荐的PMU芯片与RV1126芯片紧密配合,能够提供精确的电压轨和时序控制,确保系统的稳定运行。集成的PMU方案也简化了电源设计,提高了效率。

功能:

多路稳压输出: 为CPU、NPU、DDR、I/O等不同模块提供所需电压。

电源时序控制: 按照特定顺序上电/下电,保护芯片。

过流/过压保护: 保护电路免受异常电源条件的损害。

功耗管理: 支持不同的工作模式(如睡眠模式),优化能耗。

2.5. 其他辅助元器件

Wi-Fi/Bluetooth模块: 如基于Realtek RTL8822BE或AP6256等芯片的模块。

作用: 提供无线网络连接和蓝牙通信能力,便于远程管理、数据传输(如上传检测结果、更新模型)和与移动设备联动。

选择原因: 适用于需要无线联网的场景,模块化设计易于集成。

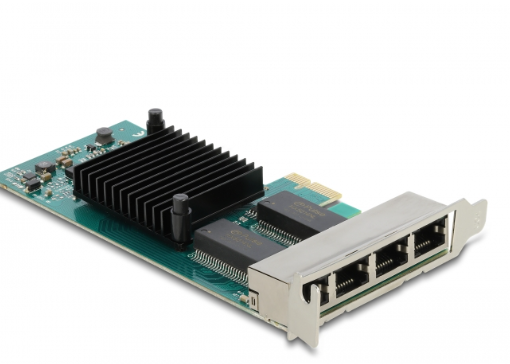

以太网PHY芯片: 如RTL8211F (千兆) 或RTL8201F (百兆)。

作用: 提供有线网络连接,确保稳定的数据传输,特别是在需要高速、低延迟传输大量图像或视频流的场景。

选择原因: 对于工业级应用或对网络稳定性要求高的场景,有线连接是首选。

USB接口控制器: RV1126内置USB Host/Device控制器。

作用: 连接外部USB设备,如U盘、USB摄像头、4G/5G模块等。

选择原因: USB是通用接口,便于扩展功能。

UART/SPI/I2C接口: RV1126内置,无需额外芯片。

作用: 用于与各类传感器(如温湿度传感器、红外传感器)、显示屏、触摸屏等进行通信。

选择原因: 嵌入式系统中常用的通信接口,灵活性强。

看门狗定时器(Watchdog Timer): RV1126内置或通过外部MCU实现。

作用: 监控系统运行状态,防止系统死机。当系统异常时,自动复位。

选择原因: 提高系统的可靠性和稳定性,在无人值守的边缘设备中尤为重要。

3. 人脸检测算法与模型部署

基于RV1126进行人脸检测,核心在于选择合适的深度学习模型并将其高效部署到NPU上。

3.1. 人脸检测算法选型

考虑到边缘侧设备的计算资源限制和实时性要求,轻量级、高精度的人脸检测算法是首选。

One-Stage 检测器: 如YOLOv3-Tiny、MobileNet-SSD或者更先进的RetinaFace(轻量化版本)、SCRFD等。

优势: 这类算法通常具有较快的推理速度,因为它们将目标分类和边界框回归在一个网络中完成。

劣势: 相较于Two-Stage检测器,可能在精度上略有牺牲,尤其是在检测小目标或复杂场景时。

推荐: SCRFD (Semi-Supervised Cascade R-CNN Face Detector):由虹软(ArcSoft)开源,在多个公开数据集上表现优异,且具有较好的鲁棒性。其轻量化版本非常适合边缘部署。也可以考虑针对移动端优化的BlazeFace或YOLO-Fastest等变体。

模型量化: RV1126的NPU支持INT8/INT16量化。将浮点模型量化为定点模型可以显著减少模型大小,降低内存带宽需求,并加速推理速度,同时尽量保持精度。这是在边缘侧部署AI模型的关键步骤。

3.2. 模型训练与优化

数据集: 充足且多样化的人脸数据集(如WIDER FACE、FDDB等)对于训练高性能模型至关重要。需要覆盖不同光照、姿态、表情、遮挡、年龄和种族等情况。

迁移学习: 可以选择在大型人脸数据集上预训练好的模型作为基础,然后针对特定应用场景的数据进行微调(Fine-tuning),以加速训练过程并提高模型性能。

模型剪枝与蒸馏: 进一步减小模型体积和计算量,在不显著降低性能的前提下,使其更适合在RV1126上高效运行。

针对NPU的优化: 利用Rockchip提供的RKNN Toolkit工具链,将训练好的PyTorch/TensorFlow/Caffe等框架模型转换为RV1126 NPU支持的RKNN格式。RKNN Toolkit会进行模型解析、量化(FP32到INT8/INT16)、优化和编译,生成可直接在RV1126上运行的推理文件。

3.3. 软件架构与实现

整个软件系统将基于Linux操作系统(通常是Buildroot或Yocto构建的精简版Linux),并利用Rockchip提供的SDK。

操作系统: 基于Linux内核,裁剪掉不必要的模块,确保系统精简高效。

驱动层: 摄像头驱动(V4L2)、NPU驱动、PMU驱动、网络驱动等,确保硬件正常工作。

媒体框架: RV1126 SDK中通常会包含RKMEDIA等媒体处理框架,用于图像和视频数据的采集、处理和传输。

人脸检测应用:

初始化RKNN上下文。

加载RKNN模型文件。

设置输入数据。

执行推理。

获取输出结果。

图像采集: 通过V4L2接口从摄像头获取原始图像帧。

图像预处理: 对图像进行裁剪、缩放、归一化等操作,使其符合NPU输入要求。RV1126的ISP和硬件加速器可以辅助完成部分预处理。

NPU推理: 调用RKNN API将预处理后的图像数据送入NPU进行人脸检测推理。

结果后处理: 对NPU输出的检测结果(边界框坐标、置信度等)进行解析,例如非极大值抑制(NMS)去除冗余框,并根据置信度阈值进行筛选。

结果呈现与应用: 将检测到的人脸框绘制到图像上进行显示(如果需要),或将检测结果(如人脸位置、数量)通过网络(MQTT、HTTP、TCP/UDP等)传输到云端或本地服务器,用于后续的人脸识别、属性分析或报警等功能。

错误处理与日志: 完善的错误处理机制和日志记录,便于问题定位和系统维护。

3.4. 开发流程与工具链

环境搭建: 搭建Linux开发主机,安装交叉编译工具链、RV1126 SDK。

模型训练: 在高性能GPU服务器上使用PyTorch/TensorFlow等框架训练人脸检测模型。

模型转换与量化: 使用RKNN Toolkit将训练好的模型转换为RKNN格式。

程序开发: 编写C/C++应用程序,调用RKNN API进行NPU推理,并处理图像输入输出。

交叉编译: 将应用程序交叉编译为RV1126目标板可执行文件。

部署与测试: 将程序部署到RV1126开发板上进行测试和调试,验证性能和稳定性。

性能优化: 根据实际测试结果,对模型进行剪枝、蒸馏或调整量化策略,优化程序代码,进一步提升系统性能。

4. 鲁棒性提升策略

为了使人脸检测方案在复杂环境中保持高鲁棒性,需要采取多方面的策略:

高质量的图像输入: 选择高感光度、宽动态范围的图像传感器,配合RV1126强大的ISP,确保在各种光照条件下都能获得清晰、细节丰富、噪声低的图像。

多样化训练数据: 训练模型时使用包含大量复杂场景(不同姿态、表情、遮挡、光照、分辨率)的数据集,并进行数据增强,使模型能够泛化到未见过的场景。

模型选择与优化: 选择本身就具有较强鲁棒性的模型结构(如具有感受野更大的特征提取网络,或引入注意力机制),并通过量化、剪枝等方式在保持性能的前提下适配边缘设备。

后处理优化: 改进NMS算法,例如使用Soft-NMS,以更好地处理重叠人脸。

活体检测(可选): 在人脸检测的基础上,集成活体检测模块,可以有效防止照片、视频欺骗,提高系统的安全性。RV1126的NPU同样可以加速活体检测模型的推理。

多帧融合(可选): 在视频流场景下,可以考虑利用前后帧的信息进行多帧融合,进一步提升检测的稳定性和精度。

硬件协同加速: 充分利用RV1126的ISP进行图像预处理,减轻CPU负担,为人脸检测提供更优质的输入。

5. 总结与展望

基于RV1126开发板实现人脸检测方案,凭借其强大的NPU算力、丰富的接口以及完善的SDK支持,能够构建出高性能、低功耗、高鲁棒性的边缘AI视觉系统。从精选的星光级图像传感器到针对NPU优化的深度学习模型,每一个环节的精心选择和设计都旨在提升系统的整体表现。

未来,该方案可以进一步扩展,例如集成人脸识别、人脸属性分析、行为识别等更高级的AI功能,以满足更复杂的应用需求。同时,随着AI模型和NPU技术的不断发展,人脸检测的精度和速度将持续提升,为智能安防、智慧城市、智能家居等领域带来更广泛的应用前景。希望本文能为基于RV1126进行人脸检测开发的工程师提供有价值的参考和指导。

责任编辑:David

【免责声明】

1、本文内容、数据、图表等来源于网络引用或其他公开资料,版权归属原作者、原发表出处。若版权所有方对本文的引用持有异议,请联系拍明芯城(marketing@iczoom.com),本方将及时处理。

2、本文的引用仅供读者交流学习使用,不涉及商业目的。

3、本文内容仅代表作者观点,拍明芯城不对内容的准确性、可靠性或完整性提供明示或暗示的保证。读者阅读本文后做出的决定或行为,是基于自主意愿和独立判断做出的,请读者明确相关结果。

4、如需转载本方拥有版权的文章,请联系拍明芯城(marketing@iczoom.com)注明“转载原因”。未经允许私自转载拍明芯城将保留追究其法律责任的权利。

拍明芯城拥有对此声明的最终解释权。

产品分类

产品分类

2012- 2022 拍明芯城ICZOOM.com 版权所有 客服热线:400-693-8369 (9:00-18:00)

2012- 2022 拍明芯城ICZOOM.com 版权所有 客服热线:400-693-8369 (9:00-18:00)