你知道什么是GPU服务器吗?GPU服务器有何不同?

16

16

拍明

拍明

原标题:你知道什么是GPU服务器吗?GPU服务器有何不同?

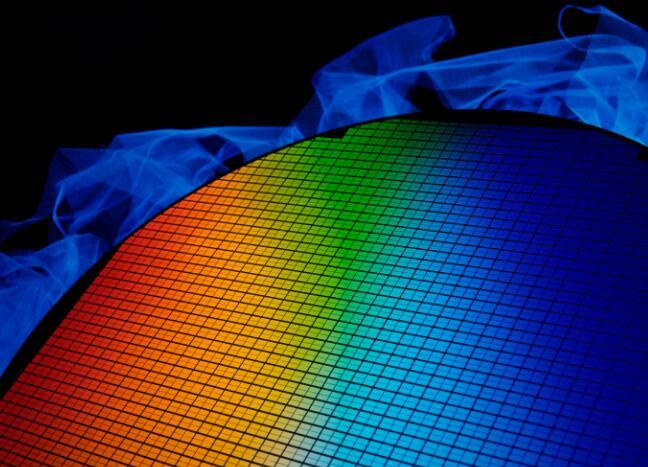

GPU服务器是一种专门配置了高性能图形处理器(GPU)的服务器,旨在提供高性能计算、深度学习、科学计算等多种场景的计算服务。以下是GPU服务器的详细介绍及其与传统服务器的不同之处:

一、GPU服务器的定义与特点

核心组件

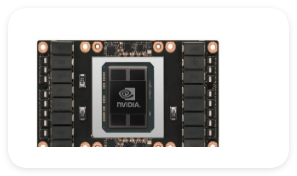

GPU服务器配备了高性能的GPU卡(如NVIDIA的A100、H100或AMD的MI系列),这些GPU具有大量并行计算核心,能够同时处理大量数据。

除了GPU,服务器通常还包含高性能的CPU、大容量内存、高速存储设备以及网络接口。

应用场景

深度学习与人工智能:加速神经网络训练和推理,缩短模型训练时间。

科学计算:用于气象模拟、基因测序、物理仿真等需要大规模并行计算的领域。

图形渲染与视频处理:提供实时渲染、视频编解码和3D建模支持。

金融分析:加速高频交易和风险评估算法。

技术优势

并行计算能力:GPU拥有数千个计算核心,适合处理大规模并行任务。

高吞吐量与低延迟:在实时数据处理和流式计算中表现优异。

支持多种编程框架:如CUDA、TensorFlow、PyTorch等,便于开发者快速部署应用。

二、GPU服务器与传统服务器的不同

硬件架构

GPU服务器:以GPU为核心计算单元,通常配备多块高端GPU卡,适合并行计算。

传统服务器:以CPU为核心,计算能力依赖于CPU的核心数和频率,适合串行任务。

计算能力

GPU服务器:在浮点运算、矩阵运算等并行任务中性能远超传统服务器。

传统服务器:在复杂逻辑处理和单线程任务中表现更优。

适用场景

GPU服务器:适用于需要大规模并行计算的场景,如深度学习、科学计算等。

传统服务器:适用于通用计算任务,如Web服务、数据库管理等。

成本与功耗

GPU服务器:硬件成本和功耗较高,但能显著提升计算效率。

传统服务器:成本和功耗相对较低,适合对计算性能要求不高的场景。

扩展性与灵活性

GPU服务器:支持通过增加GPU数量或升级GPU型号来扩展计算能力。

传统服务器:扩展性通常依赖于CPU和内存的升级。

三、GPU服务器的技术实现

NVLink与SXM模组

NVLink:NVIDIA开发的高速互连技术,用于GPU之间以及GPU与CPU之间的数据传输,显著提升系统性能。

SXM模组:NVIDIA专为高性能GPU设计的模组,集成了GPU芯片、显存、NVSwitch等组件,支持直接铺设在电路板上。

HGX与DGX服务器

HGX:由NVIDIA提供GPU模组,其他厂商(如浪潮、华硕等)组装成完整服务器,具有高度定制性和可扩展性。

DGX:NVIDIA提供的完整主机服务器,包含所有硬件组件和软件系统,适合需要即用型解决方案的大型企业。

四、GPU服务器的优势

加速计算任务:在深度学习训练中,GPU服务器可将训练时间从数天缩短至数小时。

提升数据处理效率:在大数据分析和科学计算中,GPU服务器能快速处理海量数据。

支持复杂应用:为图形渲染、视频处理等复杂应用提供强大的计算支持。

五、选择GPU服务器的考虑因素

业务需求:根据具体应用场景选择合适的GPU型号和服务器配置。

成本与预算:GPU服务器价格较高,需权衡性能与成本。

扩展性与维护:考虑服务器的可扩展性和后续维护成本。

责任编辑:David

【免责声明】

1、本文内容、数据、图表等来源于网络引用或其他公开资料,版权归属原作者、原发表出处。若版权所有方对本文的引用持有异议,请联系拍明芯城(marketing@iczoom.com),本方将及时处理。

2、本文的引用仅供读者交流学习使用,不涉及商业目的。

3、本文内容仅代表作者观点,拍明芯城不对内容的准确性、可靠性或完整性提供明示或暗示的保证。读者阅读本文后做出的决定或行为,是基于自主意愿和独立判断做出的,请读者明确相关结果。

4、如需转载本方拥有版权的文章,请联系拍明芯城(marketing@iczoom.com)注明“转载原因”。未经允许私自转载拍明芯城将保留追究其法律责任的权利。

拍明芯城拥有对此声明的最终解释权。

产品分类

产品分类

2012- 2022 拍明芯城ICZOOM.com 版权所有 客服热线:400-693-8369 (9:00-18:00)

2012- 2022 拍明芯城ICZOOM.com 版权所有 客服热线:400-693-8369 (9:00-18:00)